AIは今、私たちの社会や日常に急速に広がっています。メール文の作成や画像生成、悩み相談など、便利さを感じる場面が増える一方で、依存や偽情報などの問題も指摘されています。

第144回サイエンスカフェ「AI時代、どうしたい?」では、北海道大学人間知・脳・AI研究教育センター(CHAIN)の宮原克典さんをお招きし、AIと人間の関係を哲学・倫理学の視点から考えます。

身体と心とAI

宮原さんは「認知科学の哲学」という分野で、心とは何か、特に心と身体の関係について考えてきた研究者です。

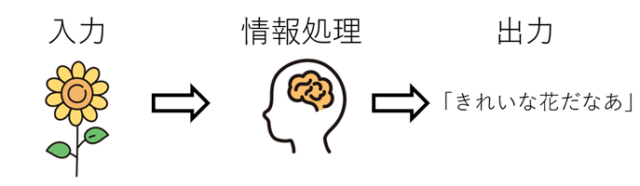

認知科学において心は、入力に対して情報処理をして何らかの出力を行うソフトウェアのようなものだと考えられ、その情報処理システムが中心に研究されてきました。

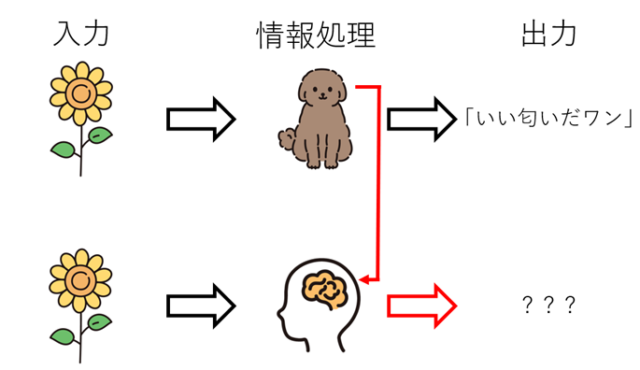

このような考え方に異論を唱えるのが宮原さんです。上記のような考え方には、「心は身体と切り離されたものである」という前提が暗に含まれていますが、宮原さんは、心と身体は密接に結びついていると語ります。

「もし心が身体と切り離されたソフトウェアのようなものだとしたら、違う身体にそのソフトウェアを搭載してもよいということになってしまう。しかし、自分の考え方や行動の癖は、この身体で生きてきた来歴と切り離せないものです。私の身体に犬の心を入れても、犬のように走り回ることはできないし、犬のように敏感に匂いを感じることはできません。」

このような考え方は「身体性認知」と呼ばれます。

身体性認知の考え方はAIについて考えるうえでも重要となります。心と身体が密接に結びついているとすると、身体を持っていないAIは人間のような心を持つことができないということになります。逆に言うと、人間のような心を持つAIを作るためには、人間のような身体性を備えたシステムが必要だと考えられます。このような議論から、「心を持つAIに身体は必要か?」という問題はある程度決着がついたと思われていました。

しかし近年の技術の進歩によって、身体を持たずとも、あたかも心を持っているかのように対話が可能なAIが登場しました。それによって、先の問題が再び議論されるようになったのだそうです。

技術=「道具」という考え方

宮原さんは「AIを理解するには、“技術と人間の関係”から考えることが重要である」と語ります。

技術は「目的を達成するための手段」としての側面を持っています。例えば、火を扱う技術、農耕などの技術はすべて、暖を取る、畑を耕すなど、人間が何らかの目標を達成するための手段として捉えることができます。このような理解では、技術そのものは中立的なものであり、人間の目標設定によって良いものにも悪いものにもなると考えることができます。

この考え方は、技術哲学における「道具主義」と呼ばれます。

全米ライフル協会による有名な言葉に、“Guns don’t kill people, people kill people.”(銃が人を殺すのではない、人が人を殺すのだ)というものがあります。このスローガンの背景には、銃は中立で使う人の目的意識によって良いものにも悪いものにもなる、という考えが潜んでいます。

技術により世界の見え方が変わる

一方で、技術には「目的を達成するための手段」以外の側面もあると考えられています。

銃の例に戻って考えてみましょう。人が人を殺すのであれば、なぜアメリカで銃規制が盛んに叫ばれるのでしょうか。なぜ、それ自体は善でも悪でもない道具を規制する必要があるのでしょうか。宮原さんは次のように指摘します。

「銃があることで人を殺すことが容易になり、銃を持った人は誰かを殺してやろうという目的意識を持ちやすくなります。目的意識に限らず、⽔⼒発電という技術が生まれると川は電⼒の源に⾒えるようになり、木を燃料として使えるようになると森や林は資源に⾒えるようになります。」

このように、技術は単なる道具ではなく、人間の「世界の見え方」を形成するものであると考えられています。このような考え方は、哲学では「技術的媒介」と呼ばれます。

技術が人間の意識に影響を及ぼす――そのことを意識すると、AIとの関係の見え方が大きく変わってきます。AIは、私たちの世界の見え方をどう変えていくのでしょうか。

もしも、自分のコピーが作れたら?

宮原さんが関心を寄せているトピックのうちの一つに、個人のデジタル複製(Personal Digital Duplicates:PDD)と呼ばれるものがあります。

自分の代わりに仕事をしてくれるAI、亡くなった家族を仮想的に再現したAI、「推し」との会話を可能にするAIなど、本人の考え方や価値観などをコピーするAI技術は既に一部で実用化されています。また、今後ロボット技術が発展し、見た目や動きが人間そっくりなロボットにAIを搭載できれば、“身体”をもったあなたのデジタル複製を作ることができるかもしれません。

宮原さんは、デジタル複製について考える意義について次のように語ります。

「例えば、自己の同一性(自分とは何か)は、興味がない人は深く考えずに通り過ぎてしまうようなトピックですが、人間をコピーできる技術が登場したことで、より現実味を帯びた話題になっています。いざ使い始めてから『結局本人はどっちだっけ?』などの混乱に陥って社会が迷子にならないよう、技術が社会に出ていく前によく考えておく必要があります。」

今回のサイエンスカフェのワークショップでは、「実在する人物を再現するAI」が身近になった未来を想像します。そこに生まれる「使ってみたい!」「少しこわいかも…」などの漠然とした感情を、哲学の視点を手がかりにしながら整理し、宮原さんとの対話を通して深掘りしていきましょう。

「AI時代、どうしたい?」

技術は人間の便利な道具であった一方で、人間の「世界の見え方」に影響を及ぼしてきました。また、近年のAI技術は人間を部分的にコピーできるようになるまで発展しました。

そんな科学技術とどう関わっていくかは、私たち自身の価値判断に関わる問題です。科学技術がどう発展していくかを傍観するだけでなく、私たち一人一人がその使い方や位置づけを考えていかなければいけません。

AIの進化が加速するこの時代に一度立ち止まり、AIは私たちの価値観にどんな影響を及ぼすのか、これから私たちはAIをどう使うべきか、そんなことを考えてみませんか?

第144回 サイエンス・カフェ札幌

【タイトル】AI時代、どうしたい? 「人とモノの狭間のなにか」を哲学する

【日 時】2025年10月19日(日)14:00~15:40(開場:13:30)

【場 所】紀伊國屋書店札幌本店 1F インナーガーデン(北海道札幌市中央区北5条西5-7 sapporo55 1F)

【ゲ ス ト】宮原克典さん(北海道大学人間知・脳・AI研究教育センター(CHAIN)准教授)

【聞 き 手】対話の場の創造実習受講生

【参 加】事前申し込み不要、参加無料

【定 員】40名(直接会場までお越しください)

【主 催】北海道大学 CoSTEP